Nvidia trình làng Vera Rubin – bước tiến lớn của hạ tầng AI toàn cầu

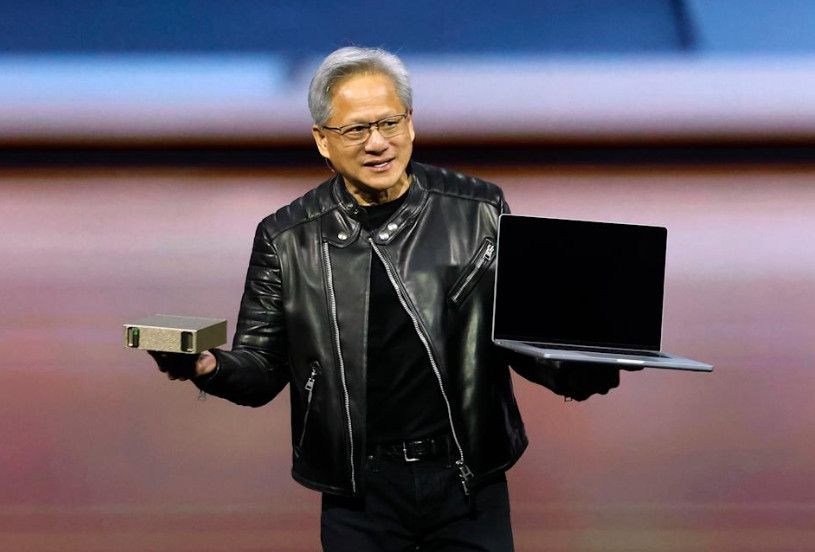

Tại CES 2026 ở Las Vegas, Nvidia – hãng công nghệ trí tuệ nhân tạo hàng đầu thế giới – chính thức ra mắt Vera Rubin, nền tảng AI chủ lực tiếp theo của công ty. Sự kiện này đánh dấu một cột mốc quan trọng trong chiến lược phát triển siêu máy tính AI của Nvidia, trong bối cảnh nhu cầu huấn luyện và suy luận trí tuệ nhân tạo đang tăng vọt trên toàn cầu.

Theo Nvidia, Vera Rubin là một trong sáu chip tạo nên nền tảng Rubin, được thiết kế như một bộ xử lý hợp nhất, kết hợp một CPU Vera và hai GPU Rubin trong cùng một hệ thống. Cách tiếp cận này nhằm tối ưu hiệu năng, khả năng mở rộng và hiệu quả năng lượng cho các mô hình AI thế hệ mới.

Rubin – nền tảng cho agentic AI và các mô hình suy luận nâng cao

Nvidia định vị Rubin là nền tảng lý tưởng cho:

- Agentic AI – các hệ thống AI có khả năng tự hành động và lập kế hoạch

- Mô hình suy luận nâng cao

- Mixture-of-Experts (MoE) – mô hình kết hợp nhiều “AI chuyên gia”, tự động định tuyến truy vấn đến mô-đun phù hợp

Theo CEO Jensen Huang, Rubin xuất hiện “đúng vào thời điểm thích hợp”, khi nhu cầu điện toán AI cho cả huấn luyện lẫn suy luận đều tăng mạnh. Ông nhấn mạnh rằng chu kỳ ra mắt hàng năm của các siêu máy tính AI, cùng quá trình thiết kế đồng bộ trên sáu chip mới, đang đưa Nvidia tiến sâu hơn vào kỷ nguyên tiếp theo của trí tuệ nhân tạo.

Hệ sinh thái Rubin: Không chỉ là CPU và GPU

Ngoài CPU Vera và GPU Rubin, nền tảng Rubin còn bao gồm bốn chip mạng và lưu trữ quan trọng:

- Nvidia NVLink 6 Switch

- Nvidia ConnectX-9 SuperNIC

- Nvidia BlueField-4 DPU

- Nvidia Spectrum-6 Ethernet Switch

Tất cả các thành phần này có thể được đóng gói thành máy chủ Vera Rubin NVL72, kết hợp 72 GPU trong một hệ thống duy nhất. Khi nhiều hệ thống NVL72 được kết nối với nhau, chúng tạo thành DGX SuperPOD – siêu máy tính AI khổng lồ mà các tập đoàn như Microsoft, Google, Amazon và Meta đang chi hàng tỷ USD để triển khai.

Giảm một nửa số GPU, hạ chi phí suy luận gấp 10 lần

Một trong những điểm nhấn lớn nhất của Rubin là hiệu quả vượt trội so với thế hệ Grace Blackwell trước đó. Nvidia cho biết:

- Rubin có thể giảm một nửa số GPU cần thiết để huấn luyện cùng một mô hình MoE

- Chi phí token suy luận giảm tới 10 lần

Trong AI, token đại diện cho các đơn vị như từ ngữ, hình ảnh hay đoạn video. Việc xử lý token tiêu tốn rất nhiều tài nguyên và năng lượng, đặc biệt với các mô hình có hàng nghìn tỷ tham số. Giảm chi phí token đồng nghĩa với cải thiện đáng kể tổng chi phí sở hữu (TCO) cho doanh nghiệp.

Để hỗ trợ điều này, Nvidia cũng giới thiệu Inference Context Memory Storage – bộ nhớ AI chuyên dụng giúp lưu trữ và chia sẻ dữ liệu sinh ra từ các mô hình suy luận đa bước.

Sản xuất hàng loạt và vị thế dẫn đầu của Nvidia

Nvidia cho biết nền tảng Rubin đã được thử nghiệm với các đối tác và hiện đang bước vào giai đoạn sản xuất hàng loạt. Vị thế dẫn đầu trong lĩnh vực chip AI đã giúp Nvidia trở thành công ty có vốn hóa lớn nhất thế giới, với giá trị ước tính khoảng 4,6 nghìn tỷ USD, dù từng vượt mốc 5 nghìn tỷ USD vào tháng 10 trước khi điều chỉnh do lo ngại bong bóng AI.

Cạnh tranh gia tăng từ AMD và các “khách hàng lớn”

Dù vậy, Nvidia đang đối mặt với sự cạnh tranh ngày càng gay gắt. AMD đang phát triển các hệ thống Helios quy mô rack để cạnh tranh trực tiếp với NVLink 72. Đồng thời, chính các khách hàng lớn của Nvidia như Google và Amazon cũng đang mở rộng việc sử dụng chip AI tùy chỉnh cho nền tảng của riêng họ, bao gồm việc cung cấp năng lượng cho Claude của Anthropic.

Theo The Information, Google còn đang đàm phán với Meta và các công ty đám mây khác để đưa chip tự thiết kế vào trung tâm dữ liệu bên thứ ba.

Tuy nhiên, giới phân tích cho rằng việc soán ngôi Nvidia trong ngắn hạn là rất khó, đặc biệt khi hãng duy trì được nhịp ra mắt sản phẩm AI hàng năm với quy mô và độ hoàn thiện vượt trội.

Vera Rubin là gì?

Đây là nền tảng AI thế hệ mới của Nvidia, tích hợp CPU Vera và GPU Rubin cho huấn luyện và suy luận AI.

Rubin hướng tới những loại AI nào?

Agentic AI, mô hình suy luận nâng cao và mixture-of-experts (MoE).

Rubin cải thiện hiệu năng ra sao so với Blackwell?

Giảm một nửa số GPU cần thiết cho huấn luyện MoE và giảm chi phí suy luận token tới 10 lần.

NVL72 là gì?

Máy chủ AI của Nvidia tích hợp 72 GPU Rubin trong một hệ thống duy nhất.

Ai là khách hàng chính của nền tảng Rubin?

Các công ty siêu quy mô như Microsoft, Google, Amazon và Meta.

Nvidia có còn dẫn đầu thị trường AI không?

Hiện tại Nvidia vẫn giữ vị thế dẫn đầu, dù phải đối mặt với cạnh tranh ngày càng mạnh từ AMD và các chip AI tùy chỉnh.

🚀 Theo dõi cuộc đua hạ tầng AI toàn cầu

Nvidia, AMD và các “ông lớn” đám mây đang định hình tương lai trí tuệ nhân tạo. Đừng bỏ lỡ các phân tích chuyên sâu về chip AI, siêu máy tính và chiến lược công nghệ toàn cầu.

*Nội dung chỉ mang tính thông tin, không phải khuyến nghị đầu tư.